La IA y la salud: el equilibrio entre innovación y privacidad del paciente

Claves éticas, legales y técnicas para transformar la medicina predictiva en una realidad humana, segura y eficiente

Hoy nos enfrentamos a una paradoja tecnológica, mientras la mayoría de los ciudadanos ven la Inteligencia Artificial (IA) con curiosidad pero con escasos conocimientos técnicos, asociando principalmente con robots, chatbots o asistentes de voz, la ciencia ya la considera una solución que puede salvar vidas. Para superar esta brecha , el 23 de abril del 2026, Villa Quartara en Genova, Italia, acogió el convenio «IA for healthcare, longetivity & wellness», organizado por Fusion AI Labs, con el objetivo de llevar la IA a los hospitales. El debate reveló un hecho crucial, el 80% de los proyectos fracasan no por limitaciones técnicas, sino por dificultades en su implementación. Entre la complejidad regulatoria y la integración de datos, el reto actual ya no se limita a la investigación, sino que se centra en la aplicación diaria. Hoy exploramos cómo trasformar estas promesas en una atención sanitaria concreta.

En este contexto de transformación digital en la medicina, entrevistamos a una de las figuras claves, el profesor Ricard Martínez, catedrático de la Universidad de Valencia y director de la cátedra de privacy y transformación digital. Experto en la intersección entre el derecho y la práctica clinica. Martínez colabora en proyectos europeos de vanguardia como Cancer Image Europe (EUCAIM), que se centra en la seguridad y la protección de datos en el uso de la IA en oncología.

P: Profesor Martínez, usted dirige una cátedra dedicada a la privacidad y transformación digital. En pocas palabras ¿Cómo podemos garantizar que nuestros datos de salud más sensibles permanezcan protegidos y anónimos cuando los sistemas de IA los utilizan?

R: «Trataré de ser sintético, aunque es un tema que tiende a la extensión debido a su complejidad. La protección de datos de salud frente a la inteligencia artificial se construye mediante un conjunto robusto de garantías que divido en tres capas esenciales: la jurídica, la tecnológica y, ante todo, la ética.

En el ámbito jurídico, hemos pasado de un marco general de protección, el Reglamento General de Protección de Datos (GDPR), a uno más especifico, el Reglamento del espacio europeo de datos de salud (EHDS), que permite la investigación con trasparencia, apoyado por la Data Governance Act (DGA), para fomentar modelos de altruismo para que los ciudadanos compartan voluntariamente su información con fines de bien común.

Tecnológicamente, aplicamos anonimización y pseudoanonimización. El sistema utiliza dos capas para proteger la identidad del paciente. Siguiendo la sentencia del Tribunal europeo de los derechos humanos de septiembre 2025 (TEDH), donde el criterio clave es la capacidad técnica del usuario para reidentificarse; si esto no es posible, los datos no se consideran personales. Más allá de la anonimización de los datos, la infraestructura debe garantir la seguridad mediante el control estricto del entorno como la exclusión de que terceros accedan a los datos. En proyectos como Cancer Image Europe (EUCAIM), utilizamos entornos de procesamiento seguros donde los datos no se descargan, garantizando trazabilidad absoluta y control total, donde no existe posibilidad de reidentificación por vinculación, o singularización.

Finalmente, la Declaración de Helsinki (2024) con el modelo ALTAI (Assessmet List for trustworthy artificial intelligence) de la Unión Europea crean el marco ético robusto y practico para la investigación medica que utiliza la IA, asegurando que la innovación tecnológica en salud respete la dignidad de la persona, la privacidad y la seguridad. Evaluamos 63 controles en siete dominios para asegurar que nuestras herramientas sean trasparentes, explicables y libres de sesgos, cumpliendo ya de forma proactiva con los estándares de la nueva ley de inteligencia artificial (AI act).»

D: Muchas personas teman perder el control sobre sus datos sensibles. En el futuro Espacio Europeo de datos de Salud, ¿tendrán realmente los pacientes la capacidad de elegir si comparten o no sus datos para la investigación?

R: «Es un error de percepción común, tememos más al estado, que gestiona datos para proteger nuestra salud, que a las corporaciones privadas, con las que compartimos información sensible a diario sin cuestionar riesgos.

Aunque el espacio Europeo de Datos de Salud (EHDS) garantiza altos estándares de seguridad y control (como la portabilidad y trazabilidad), el actual modelo de opt – out binario (todo o nada) se consideran riesgos estratégicos, ya que hace que el sistema sea vulnerable a la desinformación. La solución propuesta es un opt – out granular que permita a los pacientes elegir selectivamente qué datos compartir y con quién, conciliando así la confianza de los ciudadanos con el progreso la investigación científica.»

D: ¿Qué garantiza a un ciudadano que las decisiones tomadas con la ayuda de la inteligencia artificial sean éticas y libres de errores?

R: «En el ámbito sanitario, donde la seguridad es el activo más valioso, no dejamos nada al azar. Garantizar la ética y la fiabilidad de la inteligencia artificial no depende de una sola regla, sino de un entramado de pilares fundamentales que aseguran una protección integral:

Un doble blindaje normativo. No basta con una regulación; exigimos que toda la IA de uso médico cumpla simultáneamente con la IA act y la Medical Device Regulation (MDR). Es una protección redundante que asegura tanto la calidad técnica como la seguridad clínica. La evaluación de riesgos es rigurosa, prohibimos prácticas manipuladoras y obligamos a realizar evaluaciones de impacto sobre los derechos fundamentales antes de que cualquier herramienta llegue al paciente.

La governace de los datos y trasparencia, aquí aplicamos el rigor del GDPR para gestionar la información , combatiendo los sesgos (bias) y asegurando que quienes despliegan la tecnología tenga toda la información técnica necesaria para usarla correctamente.

Una supervisión humana innegociable, este es el núcleo de nuestro sistema. Cualquier proceso automatizado debe ser capaz de revertirse o integrarse bajo supervisión humana en cualquier punto del diseño y la ejecución.

La vigilancia post – comercialización, porque la supervisión no termina con la venta. Obligamos a los fabricantes a demostrar, mediante una trazabilidad y auditoría continua, que el sistema siga siendo seguro y eficaz una vez implementado en el entorno real.

Aplicamos la formación y responsabilidad clínica (AI literacy). La tecnologia no decide; el profesional sí. Imponemos una formación obligatoria para que los médicos y enfermeros comprendan la herramienta, reafirmando que, sea cual sea la sugerencia de la IA, la responsabilidad legal y clínica recae exclusivamente en el operador humano.»

D: ¿Cambiará la IA la forma en que interactuamos con nuestros médicos? ¿Se volverá todo más frío, o estas tecnologías nos ayudaran a una atención más humana y personalizada?

R: «La integración de la IA, la realidad aumentada (RA) y los gemelos digitales (digital Twin), no deshumanizarán la medicina, sino que permitirán una práctica más centrada en el paciente. Hoy los médicos deben atender en solo 5 o 10 minutos, lo que provoca que terminen relacionándose más con la pantalla del ordenador o con las historias clínicas en papel que con el paciente. El objetivo de estas tecnologías es eliminar esta barrera visual para que los médicos puedan dedicarse plenamente a hablar con su paciente. Dentro de 10 años la tecnología actuará como una interfaz invisible: mediante gafas de realidad aumentada, el médico podrá consultar datos biométricos y antecedentes del paciente en tiempo real, manteniendo el contacto visual y la conexión humana. Simultáneamente, el sistema procesará el historial clínico y el contexto sociogenético del paciente durante la consulta, ofreciendo diagnósticos precisos y sugerencias terapéuticas de alta eficacia. Lejos de ser una intrusión fría, este avance me parece más humano de lo que tenemos hoy.»

D: En una sociedad que envejece rápidamente, lo que ejerce una presión sobre el sistema de salud pública, ¿puede una mejor gestión de datos traducirse realmente en una reducción de costos y servicios más eficientes para la población mayor?

R: «Al adoptar una visión holística que integra factores clínicos y sociales. Transitamos de una medicina. Reactiva a una preventiva. La herramientas predictivas son el catalizador, permiten l detención precoz, por ejemplo en el screening de cáncer de mama, la inteligencia artificial puede detectar anomalías que el ojo humano aun no ve, garantizando una actuación inmediata, mayor supervivencia y un ahorro d más de 200.000 euros para el sistema de salud. En el control de pacientes crónicos, podemos monitorear los parámetros para prevenir desajustes y hospitalizaciones, trasformando lo que sería una emergencia en un simple control de rutina. Nuestro objetivo final es ambicioso. La medicina nos está regalando mucha longevidad, pero a menudo a costo de la calidad de vida. Gracias a los datos, queremos promover políticas que garanticen una longevidad sana, donde vivir más tiempo signifique vivir con una baja prevalencia de enfermedad y un alto nivel de bienestar.»

Related

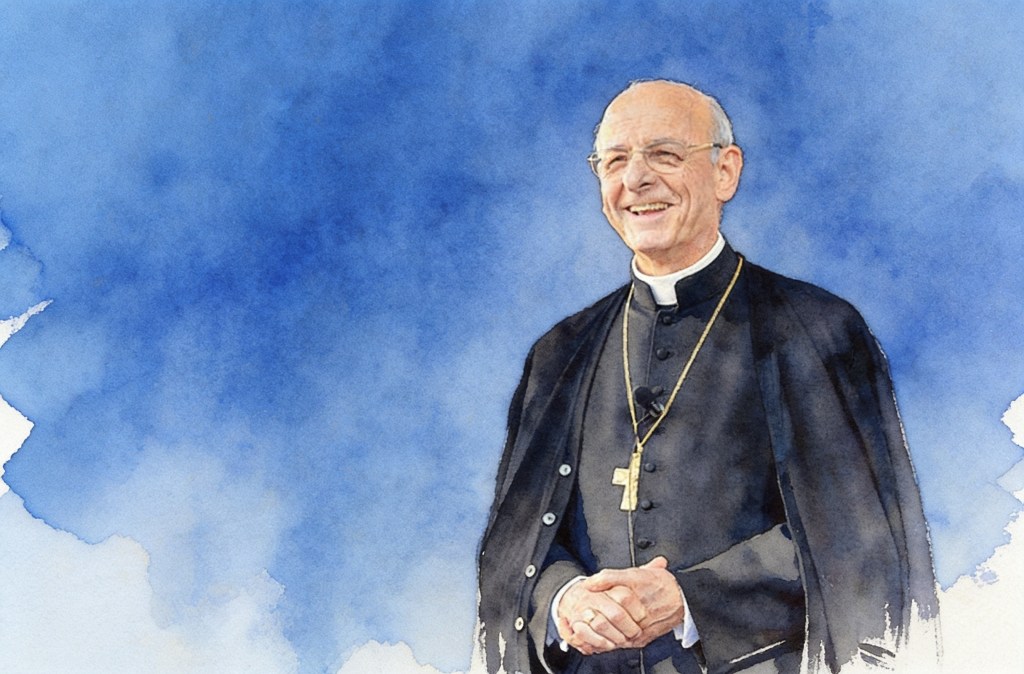

Mons. Fernando Ocáriz: «El camino más fiel para servir a la Iglesia es no ser indiferentes a las vicisitudes de nuestro mundo»

Exaudi Redacción

19 mayo, 2026

9 min

¿Rosalía cantará para el Papa? ¿Rosalía y David Bisbal? ¿Fernando Alonso al volante del papamóvil?

Valentina Alazraki

19 mayo, 2026

4 min

El hombre tras el bastón de mando: «Ser padre a los 50 es mi mayor acto de rebeldía»

Se Buscan Rebeldes

15 mayo, 2026

3 min

De la infertilidad, el pozo negro y siete bebés en el cielo al milagro doble: la historia que te hará creer de nuevo

Se Buscan Rebeldes

12 mayo, 2026

3 min

(EN)

(EN)

(ES)

(ES)

(IT)

(IT)